毎朝の日課としてITmediaの「オルタナティブ・ブログ」に、記事を投稿しています。眠い頭を目覚めさせるためのジョギングのような習慣です。先週は、そんなジョギングのテーマとして、「AIと人間の役割」について考えてみました。そこで語ったことの要約は以下の通りです。

AIは膨大なデータから規則や特徴を抽出し、「究極の一般」を導き出すことで、パターン化や一般化が可能な知的作業の生産性を高めます。一方、人間は観察や対話、共感を通じて、その場の状況における独自性や希少性、「究極の特別」を見出します。つまり、AIは知的作業の量的限界を解消し、人間は独創性や希少性を見出すことで、知性を拡張しそれぞれ単独では実現し得ない知性の発展へとつなげることができます。

AIは、これまで経験を積まなければ到達できなかった80点レベルの知的作業を迅速にこなせるようになりました。その結果、人間がスキルを身につけるために経験を積む必要性が減り、「解決すべき課題を設定する」能力がより重要になります。AIが80点を担う中で、人間は問いを立て、AIの成果を修正・拡張して100点を超える成果を生み出す役割を果たすことが大切な役割となります。

システム開発の現場では、AI駆動開発が進行し、「工数で収益を得るSIビジネス」は崩壊の危機に直面しています。多くのSI事業者やITベンダーは既存の開発プロセスの改善に注力していますが、それではAIがもたらす本質的な変化に対応できません。クラウド、アジャイル開発、DevOpsなどの「モダン開発」を前提にプロセスを再定義し、ビジネスモデルを転換する必要があります。

AIエージェント時代に求められる人間の役割は「責任」をとること

AIエージェントの登場により、ユーザーがAIと対話しながら自律的にシステムを開発できる時代が近づいています。この中で、人間の役割は課題を発見し、言語化する「高次の知的作業」へと移行します。また、結果に対する「責任」を持つことが求められます。そのために人間は、自らの未来像を描き、学びと実践を通じて独自の強みを磨くことが求められます。

昨今の急速なAI技術の進展は、「知的”力“仕事」の多くを代替し始めています。「知的”力“仕事」とは、「パターン化された知的作業」という意味です。例えば、日常の業務における報告書や調査レポート、申請書の作成、システム開発におけるコード生成やテスト作業、運用管理業務などは、既に実用の域に達しています。企画や計画の策定などの「知的”思索“仕事」や組織の運営やマネージメントなどの「知的”管理“仕事」でもAIは広範な役割を担うことになるでしょう。この流れは、もはや「既成事実」であると言っても言い過ぎではありません。

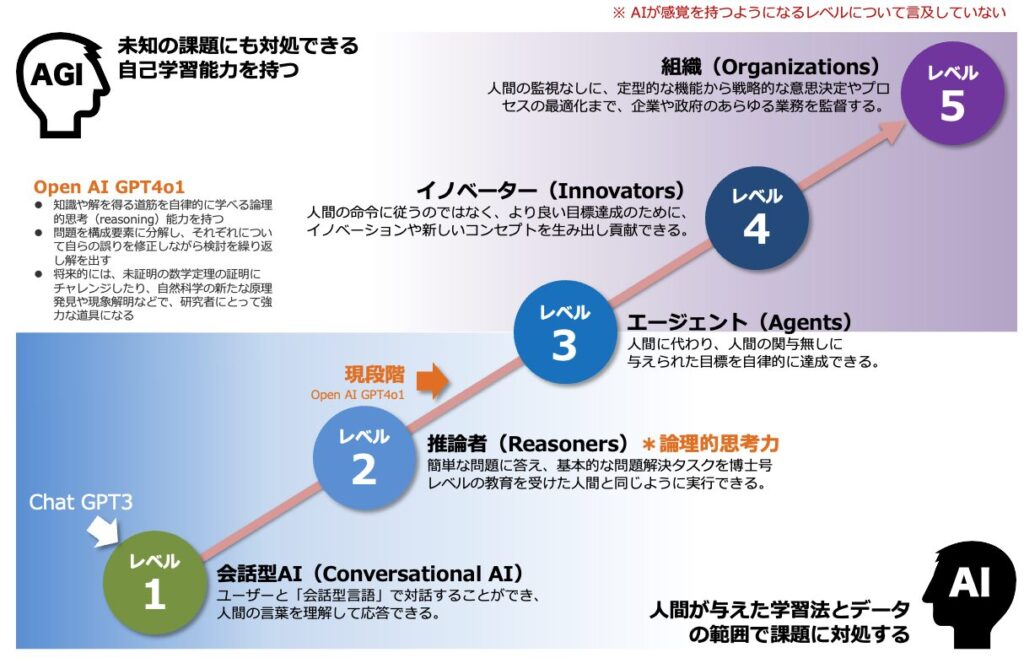

OpenAIから、「AI発展の5つの段階」という内部情報が漏れ出てきました。その内容を参考に、描いたのがこのチャートです。OpenAIが2024年9月にリリースした「ChatGPT4 o1」は、このチャートのレベル2に相当するテクノロジーとされているようです。いま、AI界隈では、この次にやってくるレベル3のAIエージェントの話題で持ちきりです。

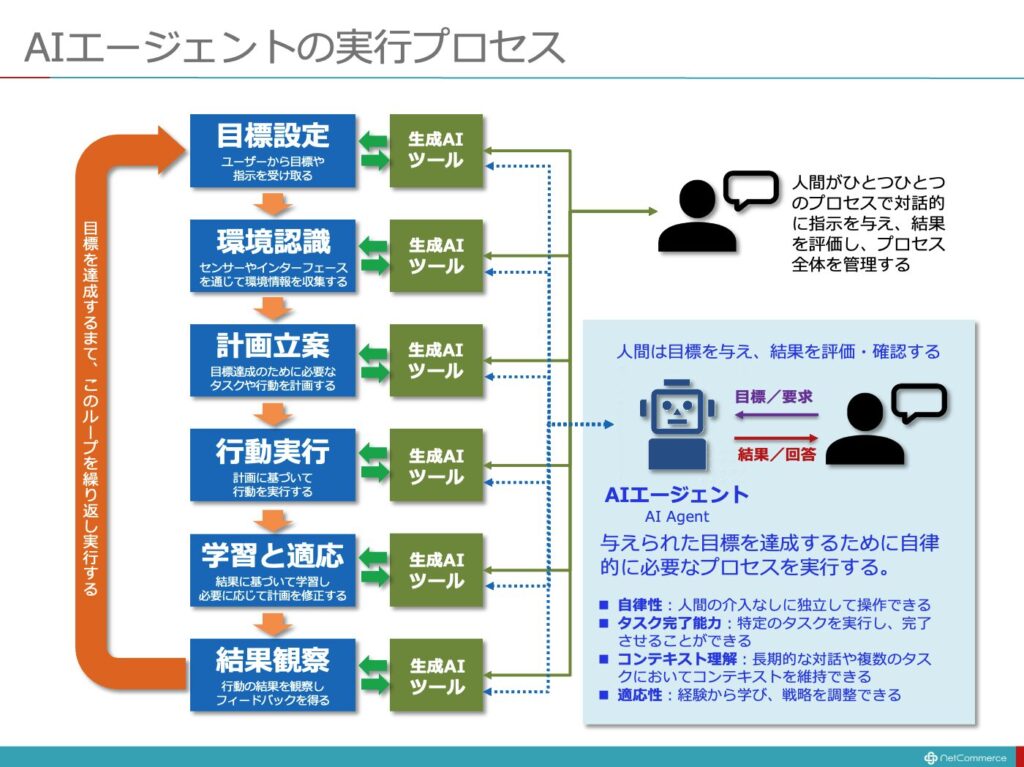

AIエージェントとは、「何をしたいのか=目標」を与えれば、自ら計画を立て、結果を評価し、うまく行かなければそれを検証し、改善するなどして、目標達成を自律的になし遂げる能力を持つソフトウェアです。つまり、人間の「エージェント(Agent)=代理人」として、仕事をこなしてくれます。「非常に賢い自分専属の秘書あるいは部下」といったところでしょうか。いまの勢いを見ていると、1年のうちにはこの分野で大きな動きが起こりそうです。現段階では、全ての知的作業をこなしてくれるAIエージェントは存在しません。しかし、特定の業務領域に特化したAIエージェントは登場し始めています。例えば、システム開発の広範なタスクをこなしてくれるBoltは、そのさきがけとも言えるサービスです。このような状況を横目で見ながら、「AIと人間の役割」について考えてみたのが、先の連載です。そこから見えてきたのは、人間の究極の役割は、「責任をとること」と「考えること」ではないかという考察です。

「責任をとること」とは、いまの社会に於いて、人間にしか果たせない役割です。AIが発展を遂げ、多くの知的作業を人よりも何倍も早く、正確にこなしてくれたとしても、その結果に責任をとれるのは、人間しかいません。「AIがこういう答えを出したのだから、仕方がありません。私はそれに従っただけです。」と責任を回避しようとしても、いまの社会が許容してくれることはないでしょう。

また、責任には「判断」が伴います。判断には、善悪、社会規範、思想や文化といった、様々な価値観に影響を受けます。AIは、そんな多様な価値観があることは教えてくれても、その中で、どの価値観に基づき選択し判断することが正しいのかは、教えてはくれません。その選択と判断は、人間に委ねられています。そして、その結果に対して、人間は、責任をとらなくてはならないのです。

人間が「責任」をとるべく判断するには、「考えること」が必要です。考えることは、人間が身体を通じて積み上げた習慣、感性、思想、文化、人間関係などが複雑に絡み合い、その判断は、状況に応じて相対的です。私たちは、これを「感覚的」であるといいます。時にして、「感覚的」な判断は、「論理的」な合理性を欠くことがあります。

私たちの日常にあっては、時にして「感覚的」な不合理性は、「論理的」な合理性を超越する存在です。論理的に正しくても、それを誰もが受け入れてくれるとは限りません。「究極の一般」を追求するAIの限界は、「状況に応じて相対的」であることを求める「人間社会の掟(おきて)」を乗り越えられない点にあると言えます。

一方人間は、その時々の状況の中で、相対的に正しい選択を迫れ、判断しなくてはなりません。つまり、人間は、「感覚的」に状況に合いふさわしい「究極の特別」を見出すことを求められます。

人間は、自らの身体を駆使して観察し、共感し、対話し、実践して、体感し、そこから得た「感覚的」知識をも加味して、考えなくてはなりません。身体を持たないAIにこの役割を担うことはできません。そして、人間は、自分が考え下した判断とその結果に対して、責任を持つことが求められます。

よりよい判断を下すには、「論理的」知識を積み上げることが大切です。しかし、それだけでは不十分です。人間関係や対話を通じて得られる人間理解、美術や文化などに親しむことにより得られる美意識、行動を起こした結果としての成功や失敗より得られる体験的ノウハウといった広範な知的体験が、現実世界におけるよりよい判断を導く上では欠かせません。

ただ、このような知的体験に限界はなく、人間は常に不完全であり続けます。だからこそ、徹底して考えて、その時々の状況に応じた特別を見出し、判断を下さなければなりません。しかし、不完全な人間の行為ですから、その判断もまた不完全です。だから自分が選択し判断したことに責任を負う必要があるのです。そして、人間はその結果から学び、考えて、選択や判断の能力を磨いていくのです。

AIはそんな不完全な人間社会の知識を学習して、規則や法則、特徴を見つけだし、共通性や汎用性の高い答えを導くことを目指します。当然ながら、そこには絶対の正解はありません。AIの導く答えは、あくまで確率的な確かさでしかないのです。しかし、多くの知的作業においては、特にパターン化、一般化できる知的作業(知的力仕事)においては、個別であり特別は例外として排除され、確率的確かさが、高い生産性をもたらします。この点に於いて、AIは極めて強力です。

しかし、全ての状況がパターン化、一般化できるわけではありません。むしろ現実は、そうでないことに満ちているし、そこにこそ、新たな発展のきっかけがあります。

最適な判断は、時に既存の一般常識を逸脱するところにあります。それが、個別性や希少性の高いものであれば、そこには大きな価値が生まれます。これこそが、AIにはできない人間ならではの独創性なのです。

AIは、「究極の一般」をめざし、これからも知的生産性を高め続けるでしょう。その結果として、パターン化、一般化できる「知的”力“仕事」から人間は解放されます。また、「知的”思索“仕事」や「知的”管理“仕事」に必要な情報の整理や評価、管理や運用のための負担を軽減してくれます。人間は、そうして生みだされた時間や機会を使って、「考えることに」これまで以上に邁進できるようになるはずです。そして、考えた結果として、相対的な最適を見つけて判断し、その結果に「責任」を負い、社会を変えていくのです。

「考えて判断し、結果に責任を負う」というのは、いまも昔も変わらぬ人間社会の原理です。これは、AIが発達した未来でも変わることはありません。AIは、その前段として、人間にとって大きな負担となっていた知的作業を軽減し、人間は「考えて判断し、結果に責任を負う」ことに徹底して役割を移すことができるようになったとも言えます。

AIの機能や性能の向上で、人間は、人間にしかできないことに意識や時間を集中できるようになり、社会の発展にこれまでにも増して貢献して、人間や社会の進歩が加速する

私たちはいま、そんな未来をリアルに描けるようになったのだと思います。

神社の杜のワーキング・プレイス 8MATO

8MATOのご紹介は、こちらをご覧下さい。